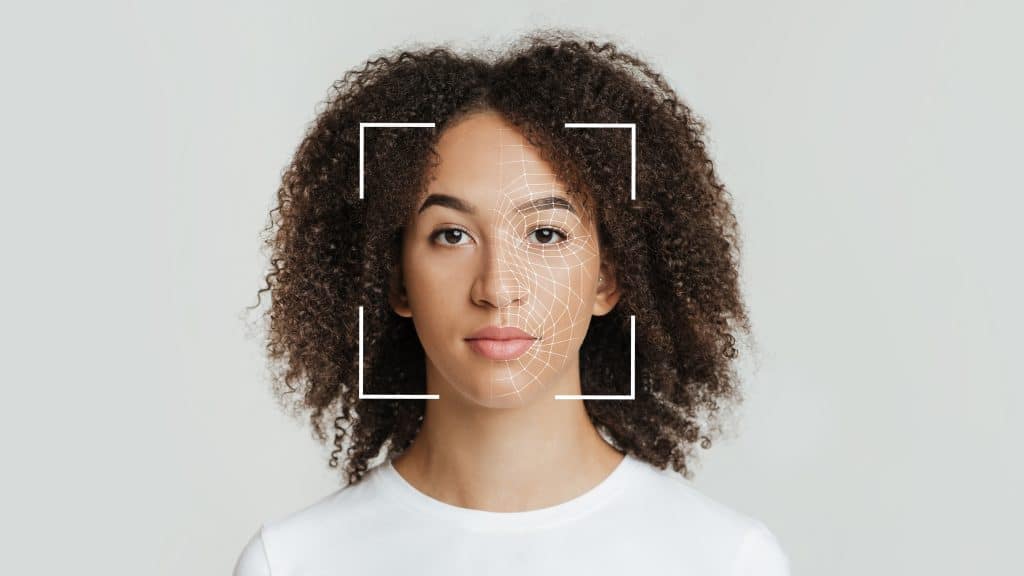

A fő problémaként említett faji elfogultság és az elszámoltathatóság hiánya.

Van egy kicsi, de egyre növekvő lobbi olyan emberekből, akiket tévesen tartóztattak le az arcfelismerő technológia következtében. Köztük van Robert Williams amerikai is, akit 2020-ban bilincseltek meg családja előtt, miután a rendőrség arcfelismerése tévesen gyanúsítottként azonosította egy szövetségi lopási ügyben.

A Williams most arra kéri az írországi rendőrséget, hogy vessék el a biometrikus technológia bevetésére vonatkozó terveit. Az Ír Állampolgári Jogok Tanácsa (ICCL) által szervezett dublini eseményen tett megjegyzésekben, amelyeket közleményben adtak ki, Williams rámutat arra a kockázatra, amely a színes bőrűek téves azonosítására hajlamos eszközök használatával jár.

„Szövetségi tanulmányok kimutatták, hogy az arcfelismerő rendszerek akár 100-szor gyakrabban azonosítják félre az ázsiai és fekete embereket, mint a fehéreket” – mondja Williams. „Amerikában megpróbáljuk helyrehozni azokat a károkat, amelyeket az FRT már okozott. Itt, Írországban, lehetősége van arra, hogy ne vezesse be először. Remélem, hogy az ön kormánya meghallgatja az enyémhez hasonló tapasztalatokat, és kétszer is meggondolja, mielőtt bevonja az FRT-t a rendőrségbe.”

Williams hivatkozik a NIST 2019-es jelentésére , amelyet azóta frissítettek , és azt mutatják, hogy egyes algoritmusok 10-100-szor nagyobb valószínűséggel azonosítottak félre egy fekete vagy kelet-ázsiait, mint egy fehér arcot. A kiértékelt algoritmusok közül azonban nem mindegyiket használják kereskedelmi forgalomba, másoknál pedig észrevehetetlen különbségek mutatkoznak a demográfiai jellemzők teljesítményében, ezért a NIST biometrikus szabványok és a tesztelés vezetője, Patrick Grother arra ösztönözte az arcfelismerést alkalmazókat, hogy legyenek specifikusak az elfogultság értékelése során.

Williams amerikai kijelentése is vita tárgyát képezheti, tekintettel arra, hogy az arcfelismerő technológiát a bűnüldöző szervek országszerte elterjesszék. És bár igaz, hogy az ír rendőrség továbbra is dönthet az arcfelismerés továbbadása mellett, ez nem valószínű. A kormány folyamatban van olyan jogszabály kidolgozásán, amely Gardaínak hozzáférést biztosítana az FRT-hez. A szomszédos Egyesült Királyságban pedig a rendőrség abszolválva alkalmazta az arcfelismerést .

Nem is csak szigetről van szó. A svéd rendőrség jelenleg a még mindig friss mesterségesintelligencia-törvény korlátai ellen törekszik, és azt tervezi, hogy 1:N arcfelismerést telepít a közterületekre. A kanadai rendőrség pedig nemrég szerződtette az Idemiát az arcfelismerő szolgáltatások nyújtására .

Az Egyesült Államokban mindenki fekete színű, akit tévesen azonosított az arcfelismerés

A visszaszorítás azonban az Atlanti-óceán mindkét oldalán folytatódik. Egy közlemény szerint a Center for American Progress (CAP), a Lawyers’ Committee for Civil Rights Under Law és 14 másik polgári jogi és érdekképviseleti csoport levelet küldött a National Institute for Justice (NIJ) számára a mesterséges intelligencia bűnözésben való felhasználásával kapcsolatban. igazságszolgáltatási rendszer, válaszul az NIJ információkérésére az üggyel kapcsolatos közelgő jelentés előtt.

„A feketék és más színes bőrűek jelentős polgárjogi sérelmekkel szembesülnek a mesterséges intelligencia bűnüldöző általi használatából eredően” – áll a közleményben. „A bűnüldöző szervek által használt algoritmikus technológiák megismétlik és megerősítik a meglévő faji elfogultságot és diszkriminációt; az olyan rendészeti technológiák, mint az arcfelismerés, a kockázatértékelés és a prediktív rendészeti eszközök gyakran lehetővé teszik és felgyorsítják ezt a tendenciát.”

A koalíció szerint a mesterséges intelligencia által vezérelt biometrikus eszközök kifejlesztésében és bevezetésében elfogultság van . Vádló ujjal a mesterséges intelligencia-motorok képzésére használt adatbázisokra mutat – „nagy adathalmazok, amelyek hemzsegnek a pontatlanságoktól, és tükrözik a meglévő társadalmi elfogultságokat és egyenlőtlenségeket”. Ezenkívül a statisztikák azt mutatják, hogy az arcfelismerést használó emberi rendőrök is hajlamosak az elfogultságra.

„Például – áll a levélben – egy közelmúltbeli jelentés megállapította, hogy a New Orleans-i rendőrség aránytalanul használt arcfelismerő technológiát („FRT”) fekete egyének azonosítására; az esetek több mint 90 százalékában a feketéken alkalmazták a technológiát.”

Az Egyesült Államokban az arcfelismeréssel tévesen azonosított és jogtalanul letartóztatott hét ember fekete színű.

Nem a faji elfogultság az egyetlen probléma. A koalíció szerint az átláthatóság is hiányzik. „A titokba burkolt bűnüldöző szervek mesterséges intelligencia-technológiákat használnak – a rendőrségi megfigyeléstől a gyanúsítottak azonosításáig és a börtönkezelési eszközökig – érdemi nyilvános hozzájárulás vagy felügyelet nélkül.” Átláthatóság nélkül nincs elszámoltathatóság.

A levél négy ajánlással zárul arra vonatkozóan, hogy az NIJ-nek mire kell kitérnie a következő jelentésében. Inkább követeléseket olvasnak.

Először is, „be kell tiltani, hogy a bűnüldözés fajilag megkülönböztető technológiákat használjanak, beleértve az FRT-t és a prediktív rendészeti eszközöket”.

Másodszor, „az algoritmikus felügyeleti eszközök használatát meg kell tiltani nyilvános helyeken és minden olyan környezetben, amely meghiúsíthatja az első kiegészítéssel kapcsolatos jogok gyakorlását”.

Harmadszor: „A bűnüldözési célokra használt mesterséges intelligencia-technológiák bevezetése előtti és utáni független auditálását kell előírni.”

Végezetül „az AI-technológiák bűnüldözési használatát fel kell tárni a büntetőügyek vádlottainál”.